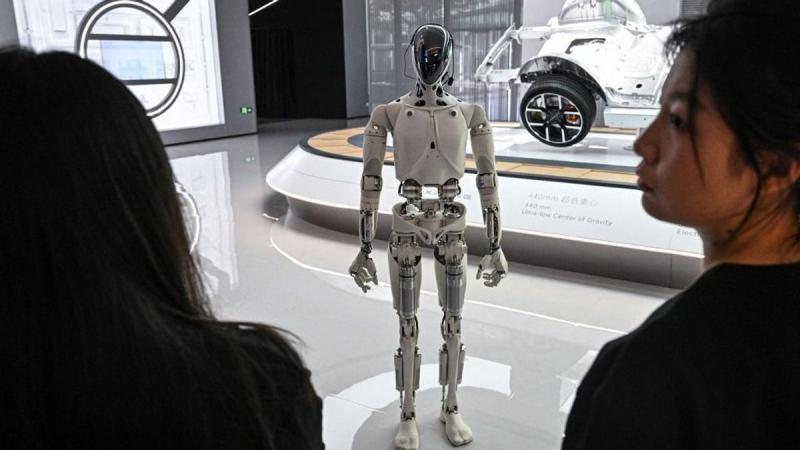

Tudja-e, mikor áll Ön előtt egy robot, és beszélget vele?

Néhány amerikai állam új szabályozásokkal lép fel, amelyek kötelezik a vállalatokat, hogy őszintén tájékoztassák a felhasználóikat: ha mesterséges intelligencia válaszol a panaszainkra, vagy összefoglalja a leveleinket, ezt nyíltan jelezniük kell. A kérdés körüli diskurzus intenzív: vajon az átláthatóság növeli a bizalmat, vagy éppen ellenkezőleg, gátolja az innovációt?

Képzeljük el, milyen zavarba ejtő helyzetbe kerülhetünk – sokan közülünk már átélhették ezt a tapasztalatot –, amikor egy ügyfélszolgálati chatbot válaszol a panaszunkra, de hosszú ideig azt hisszük, hogy egy igazi emberrel beszélgetünk. Csak akkor derül ki, hogy mesterséges intelligenciával van dolgunk, ha kifejezetten rákérdezünk. Vagy ott van például, amikor egy e-mail-szolgáltatás automatikusan összefoglalja a címzettnek írt leveleinket, mindezt anélkül, hogy előzetesen értesítene minket. Egy felhasználó ennek hatására úgy döntött, hogy más szolgáltatóra vált, mert zavarta, hogy az MI beleszól a gondolkodás szabadságába. Nem akarta, hogy egy személytelen algoritmus döntsön arról, mi számít fontosnak egy-egy személyes elektronikus üzenetben. Ez a jelenség jól érzékelteti a tétet: az átláthatóság nem csupán kényelmi szempont, hanem alapvetően a felhasználói autonómia védelméről is szól.

Fontos előrebocsátani, hogy az USA-ban nincs egységes szövetségi MI-törvény, így az államok - egyelőre legalábbis - önállóan léptek. Ez azonban mozaikszerű rendszert hoz létre, amelyben a vállalatoknak államonként kell alkalmazkodniuk - ami növeli a költségeket. Az MI-szabályozás terén Utah volt az úttörő: 2024 májusától kötelező jelezni, ha generatív MI-t használnak a fogyasztói interakciókban.

A törvény világosan kifejezi: az MI által elkövetett hibákért az üzemeltető cég vagy intézmény vállalja a felelősséget. Ezen a téren idén finomításokat hajtottak végre, és a szabályozás szigorodott, különösen a mentális egészségi chatbotok esetében, ahol csökkentették a kötelező jelölések számát.